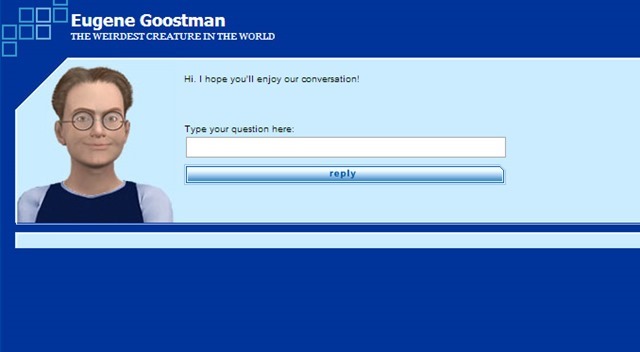

Le test de Turing** a été passé par un chatbot* appelé "Eugene Goostman", le week-end dernier, en convainquant 33% des juges humains qu’il était lui-même humain.

*ChatBot : un programme qui utilise des logiciels d’intelligence artificielle pour interagir et tenir des conversations avec des utilisateurs humains.

**Le test de Turing, proposé par le mathématicien et briseur de code (secret) Alan Turing dans une publication en 1950, cherche à savoir si les humains peuvent détecter s’ils parlent à des machines, dans ce cas, un chatbot simulant un garçon de 13 ans, ou à des humains. Si un ordinateur est pris pour un être humain dans 30% du temps, au cours d’une série de cinq minutes de conversations au clavier, il passe le test.

Au-delà de ça, la conception et les protocoles de l’essai ne sont pas précisément définis, y compris le domaine de connaissance du bot (limité à 13 ans ici), la compétence des juges et d’autres facteurs. D’ailleurs, les mots “test de Turing” ont été appliqués à tout un tas de concours similaires à travers le monde.

Cependant, cet évènement impliquait des tests de comparaison simultanés, une vérification indépendante et, surtout, les conversations étaient sans restriction. Un vrai test de Turing ne définit pas les questions ou les sujets avant les conversations.

L’évaluation s’est déroulée au cours du Turing Test 2014 qui s’est tenue à la Royal Society à Londres pour le 60e anniversaire de la mort de Turing, et produit par l’Université de Reading en partenariat avec la RoboLaw, une organisation financée par l’Union Européenne examinant la règlementation des technologies robotiques émergentes. Le logiciel a été développé en Russie par Vladimir Veselov, Eugene Demchenko, et Sergey Ulasen.

Les essais comportaient notamment :

- Des tests de simultanéités comme spécifiés par Alan Turing

- Chaque juge était impliqué dans 5 tests en parallèle, soit 10 conversations

- 30 juges y ont pris part

- 300 conversations ont été tenues

- Pour chaque période de 5 minutes, les juges communiquaient à la fois avec un humain et une machine

- Chacune des 5 machines a réalisé 30 tests

- Pour garantir l’exactitude de résultats, l’épreuve a été jugée de façon indépendante par le Professeur John Barnden, de l’Université de Birmingham.

Est-ce un exemple d’Intelligence Artificielle (AI) ?

Il convient de noter que ce n’est pas la première fois qu’un chatbot passe le test de Turing; c’était déjà le cas en 2011, avec le Cleverbot. Eugène n’est pas un superordinateur, il n’est pas artificiellement intelligent ou conscient comme de nombreux médias le prétendent. Cela a à voir en grande partie avec l’importance exagérée que beaucoup de personnes attribuent aux tests de Turing et qui datent un peu.

Il est également important de noter que les chatbots, quoiqu’impressionnants, n’ont pratiquement aucune influence sur le développement de l’intelligence artificielle. En effet, le test de Turing, a dégénéré en un concours qui vise à tromper les juges en leur faisant croire qu’ils sont en interaction avec un humain. Ce n’est certainement pas ce qu’Alan Turing avait en tête, quand il a présenté son concept, il y a une soixantaine d’années.

Le robot de conversation ne fait qu’employé, écrans de fumée et effet de miroir. Il n’y a pas de pensée ici, juste des réponses quasi préprogrammées émergeant d’algorithmes sophistiqués. Mais parce que la conjecture de Turing visait à l’évaluation de la présence de cognition similaire à l’humaine dans une machine, son test tombe à plat. Il n’a pas résisté à l’épreuve du temps et doit être soit retiré, soit affiné.

Les critiques de l’essai font également valoir que le critère de comportement intelligent de Turing est insuffisant et sans rapport avec l’IA. Ce qui importe, c’est que l’ordinateur puisse démontrer une capacité cognitive, indépendamment du comportement. En effet, il n’est pas nécessaire pour un programme de parler pour être considéré comme “intelligent”. Ainsi, beaucoup d’humains et de systèmes intelligents échoueraient probablement au test de Turing. Au mieux, on peut dire que celui-ci peut évaluer un très petit (et insuffisant) sous-ensemble de comportements humains.

Le test de Turing omet également de tenir compte de la conscience de soi ou de la sensibilité dans une machine. Le problème est en partie dû au fait qu’il confonde l’intelligence avec la sensibilité; il teste seulement comment les sujets agissent et réagissent, des comportements qui peuvent être simulés.

Ce n’est là qu’une partie des nombreuses critiques qui visent les personnes ayant tendance à comparer Eugène à une intelligence artificielle…

Néanmoins, comme ses créateurs le notent, il pourrait être très néfaste dans le domaine de la cybercriminalité :

Avoir un ordinateur qui peut tromper un homme en le conduisant à penser qu’il est une personne, est un réveil à la cybercriminalité. Le test de Turing est un outil essentiel pour lutter contre cette menace.

Vous pouvez tester Eugene Goostman ici, à condition qu’il ne soit pas débordé…

L’annonce sur le site de l’université de Reading : Turing Test success marks milestone in computing history.

J’ai lu un petit article qui précisait que le robot « Eugène » montrait très vite ses faiblesses. Notamment à travers l’orthographe, qui le perturbe pas mal, et se « besoin » de recentrer la conversation vers des algorithmes qu’il connait.

J’ai passé quelques minutes à « discuter » avec le formulaire (je ne vois pas trop comment appeler ça autrement), et franchement je ne vois pas comment il est capable de passer le test. Il est largué dès les premières phrases.

Il n’a aucune capacité à réutiliser les phrases précédentes. Il repose toujours les même questions, exactement sous la même forme, il renvoie des réponses identiques à des questions différentes… bref, bien foutu, mais juste un programme, pas de quoi berner un humain, même un enfant à mon avis.

En fait ça dépends des conversations, ce matin j’ai essayé de le « piéger » et il a très bien su répondre, j’aurais sans doute pas pu faire la différence avec un humain. Mais c’est surement parce qu’il a été « entrainé » à ce genre de questions.

Au contraire là, j’ai décidé de lui parler normalement, il m’a demandé quel métier je faisait, et je l’ai complétement perdu ensuite. Bon, disons que mon métier n’est pas des plus compréhensible pour un garçon de 13 ans, mais quand bien même, plutôt que de poser des questions ou d’admettre qu’il comprenait pas (comme un humain) il a fait des pirouettes pour me faire reformuler mes phrases, puis il m’a sorti des phrases hors contexte avant de changer complément de sujet et de me parler de son cochon d’inde…

@ NicoM :

Il faut voir que si tu utilises du français « l’engin » aura peut être du mal car nativement il a été développé par des anglo-saxons

Enfin sur quelle langue anglo-saxonne se base t il ? Il y a une différence entre la langue américaine ( mélange d’anglais , d’amérindien , d’africain , de français , etc… ( tout ceci est relatif à l’histoire du pays ) et l’anglais .

En fait, convaincre 33% des juges qu’Eugene est humain est un score lamentable.

si les juges avaient eu un doute, ils auraient voté « à pile ou face », et donc le test de Turing sera passé lorsque plus de 50% d’un grand nombre de juges voteront « humain ».

Le score de 33% me semble parfaitement correspondre à la situation ou le juge se dit : il y a 3 possibilités : 1) c’est vraiment un ordinateur qui essaie de se faire passer pour humain 2) c’est un humain qui essaie de prouver qu’il est humain 3) c’est un humain qui singe un ordinateur.

Et au moment du test il se dit : c’est trop nul, ça ne peut pas être l’option 2, donc restent 2/3 possibilités, je vote à pile ou face : 1/3 des votes donnent l’option 1.

@vhu

L’engin n’a pas été développé par des anglo saxons, mais par un russe et un ukrainien… La nuance est importante.