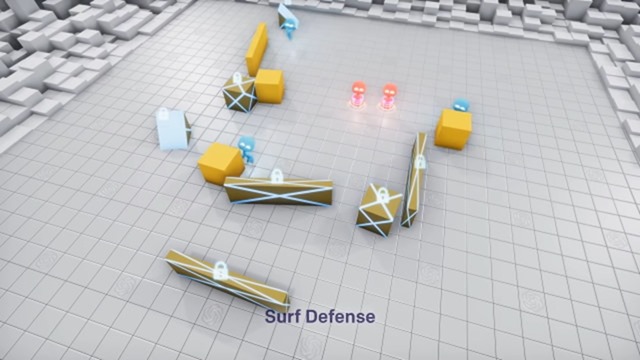

Des agents virtuels d’intelligence artificielle utilisent des stratégies inconnues pour simuler des jeux de cache-cache

Des agents virtuels d’Intelligence artificielle (IA) ont joué à des millions de parties de cache-cache pour apprendre les meilleures stratégies d’utilisation des différents outils (rampes et barricades).

Dans leur quête pour « s’assurer que l’intelligence artificielle profite à toute l’humanité », les chercheurs d’OpenAI (Californie/ États-Unis) ont découvert que leurs agents IA virtuels engagés dans un jeu simulé de » cache-cache » avaient appris six nouvelles stratégies distinctes pour jouer le jeu hors du cadre prévu à l’avance.

Grâce à une formation dans notre nouvel environnement simulé de cache-cache, les agents construisent une série de six stratégies et contre-stratégies distinctes, dont certaines que nous ignorions que notre environnement supportait. La complexité émergente de l’auto-supervision dans cet environnement simple suggère en outre que la co-adaptation multi-agents peut un jour produire un comportement extrêmement complexe et intelligent.

Ce type surprenant de comportement d’apprentissage suggère une motivation intrinsèque et/ou une compétition avec les autres, bien que les chercheurs n’aient pas encore tout compris.

Nous avons montré que les agents peuvent apprendre à utiliser des outils sophistiqués dans un simulateur de physique haute fidélité ; cependant, de nombreuses leçons ont été tirées en cours de route vers ce résultat. Construire des environnements n’est pas facile et il arrive souvent que les agents trouvent un moyen d’exploiter l’environnement que vous construisez ou le moteur physique d’une manière non intentionnelle.

Sur le site d’OpenAi : Emergent Tool Use from Multi-Agent Interaction.

[totaldonations_circle_bar id="81539"]

Il n'y a pas de publicité ici et le Guru tente, cette semaine, de réunir les fonds nécessaires pour continuer à faire vivre GuruMeditation. On y est presque et votre aide est absolument nécessaire et cela se passe ici.