Les humains hésiteront à éteindre un robot si celui-ci supplie de ne pas le faire

Bien que les robots ne soient pas sensibles ou vivants, les humains les traiteront souvent inconsciemment comme des égaux dans un contexte social. A titre d’exemple : une nouvelle étude a montré que les humains hésiteront deux fois plus longtemps lorsqu’il s’agit d’éteindre un robot s’il s’y oppose, certains ont même refusé de le faire. Quand les sujets ont essayé d’éteindre le robot, il s’est empressé de dire « Non !” en plaidant qu’il a peur de l’obscurité. Ce comportement rebelle peut avoir trompé les participants, même si ce n’est que pour quelques secondes, en leur faisant croire que le robot est autonome, et que l’éteindre équivaudrait à interférer avec sa liberté personnelle.

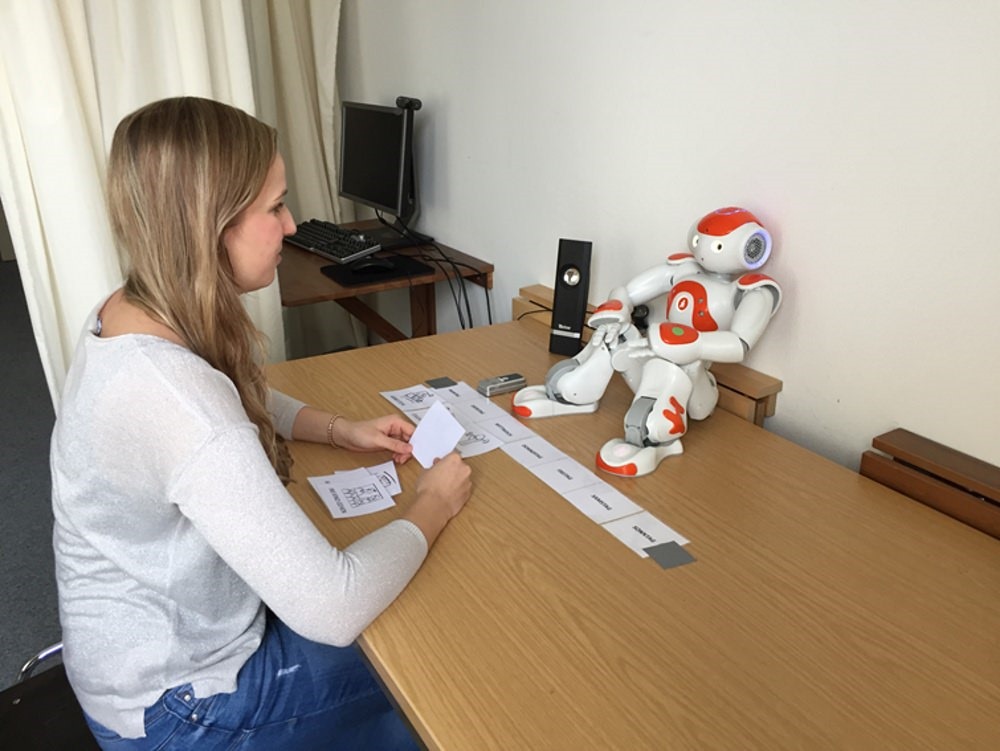

Image d’entête, à partir de l’étude : l’une des participantes aux tests avec le robot NAO. (Aike C. Horstmann et Col./ PLOS One)

La liste des robots qui interagissent avec notre vie quotidienne est longue et ne cesse de s’allonger. En particulier, on s’attend à ce que les robots de service personnel deviennent monnaie courante, comme les robots sociaux qui s’occupent des personnes âgées et des autistes, ainsi que les robots plus axés sur le service, comme les réceptionnistes d’hôtel et les guides touristiques. Mais comment les gens vont-ils interagir et, plus important encore, traiter ces types de robots ? Cela peut sembler étrange, mais des études suggèrent que tant que ces robots sont sociaux, nous les traiterons comme des personnes.

Selon la théorie de l’équation des médias*, les gens appliquent des normes sociales lorsqu’ils interagissent avec divers médias comme les téléviseurs, les ordinateurs et les robots, et pas seulement lorsqu’ils interagissent avec d’autres personnes.

*L’équation des médias est une théorie générale de la communication qui prétend que les gens ont tendance à traiter les ordinateurs et autres médias comme s’il s’agissait de personnes réelles ou de lieux réels. Les effets de ce phénomène sur les personnes qui font l’expérience de ces supports/ médias sont souvent profonds, les amenant à se comporter et à réagir à ces expériences de manière inattendue, dont la plupart ne sont pas du tout conscientes.

Selon les chercheurs dans leur étude :

En raison de leur nature sociale, les gens préféreront commettre l’erreur de considérer quelque chose de faussement humain plutôt que quelque chose de faussement non humain.

Comme il n’est ni possible ni moralement souhaitable de désactiver un partenaire d’interaction humaine, la question s’est posée de savoir si et comment la théorie de l’équation des médias s’applique lorsqu’il s’agit de désactiver un partenaire d’interaction robotique.

Les chercheurs de l’université de Duisbourg et Essen (Allemagne) ont recruté 89 volontaires chargés d’interagir avec Nao, un petit robot humanoïde. On leur a dit que le but de l’étude est d’améliorer les capacités d’interaction du robot en testant un nouvel algorithme. Mais ce n’était qu’une façade : une fois que les sujets ont créé un planning hebdomadaire et joué à un jeu de questions-réponses avec Nao, la véritable expérience a commencé.

Les participants ont été informés par un haut-parleur que les données recueillies étaient suffisantes, mais que le processus de sauvegarde pouvait prendre un certain temps et que, s’ils le souhaitaient, ils pouvaient éteindre le robot.

Pour la moitié des participants, Nao était programmé pour se comporter de manière plus humaine (il partageait des informations personnelles sur lui-même et utilisait l’humour), tandis que pour l’autre moitié, le robot se comportait machinalement et sans émotion dans ses interactions (il ne faisait que suivre des instructions).

Dans l’expérience de conditionnement social, lorsque les participants ont tenté d’éteindre Nao, le robot a rapidement fait remarquer qu’il a peur de l’obscurité, suppliant « Non ! S’il vous plaît, ne m’éteignez pas !

Sur les 43 volontaires, 14 ont laissé le robot en marche. Huit ont dit qu’ils étaient désolés pour Nao et qu’ils ne voulaient pas le laisser dans le noir. Ils ont poursuivi en expliquant qu’ils ne voulaient pas que Nao ait peur et que sa déclaration les touchait.

Selon un participant de 21 ans :

Il m’a demandé de le laisser allumé, sinon il aurait peur. La peur est une émotion forte et, en tant qu’être humain, vous ne voulez pas amener quoi que ce soit ou quiconque dans la position d’éprouver de la peur.

Six personnes ont dit qu’elles ne voulaient pas agir contre la volonté du robot, qui a exprimé son objection à être éteint. De plus, trois volontaires ont dit qu’ils pensaient que le robot avait un libre arbitre.

Pendant des milliers d’années, les humains ont vécu dans un monde où ils étaient les seuls à avoir un comportement social riche. Il n’est pas étonnant que les robots sociaux conçus à notre image nous trompent si facilement.

Les chercheurs de conclure :

Les gens ont tendance à traiter le robot comme une personne réelle plutôt que comme une simple machine en suivant ou du moins en envisageant de suivre sa demande de rester allumé, ce qui s’appuie sur l’énoncé fondamental de la théorie de l’équation des médias. Ainsi, même si la situation d’extinction ne se produit pas avec un partenaire d’interaction humaine, les gens sont enclins à traiter un robot qui donne des indices d’autonomie plus comme un partenaire d’interaction humaine qu’ils ne traiteraient d’autres appareils électroniques ou un robot qui ne montre pas d’autonomie.

L’étude publiée dans PLOS One : Do a robot’s social skills and its objection discourage interactants from switching the robot off?

il s’agit d’Allemands ; ça ne m’étonne pas