Les scientifiques du LHC confirment qu’ils n’ont finalement pas trouvé de nouvelle particule

Hier, lors d’une conférence à Chicago, il a été confirmé que les premiers indices d’une possible nouvelle particule exotique au Grand collisionneur de hadrons, en Suisse, ne sont plus.

Tout a commencé en décembre dernier, quand deux expériences distinctes avec le LHC tout juste rénové ont découvert qu’ils avaient trouvé en même temps des traces alléchantes d’une particule exotique non prédite par le modèle standard de la physique des particules, peut-être un cousin plus lourd du boson de Higgs, ou l’insaisissable graviton , un quantum porteur de la force de gravité. Les constatations à l’époque n’étaient pas assez solides pour annoncer la découverte, mais les deux expériences ont rapporté des preuves d’un signal exactement au même endroit dans les données.

Image d’entête : des paires de photons (vert) produits lors des collisions du LHC suggéraient l’existence d’un boson avec une masse de 750 gigaélectronvolts. (CMS / CERN)

Dès le début, bon nombre de scientifiques ont mis en garde que ces types de signaux disparaissent généralement alors que de nouvelles données sont ajoutées au mélange et les physiciens ont analysé avec frénésie les nouvelles données depuis.

Il y a quelques semaines, des rumeurs circulaient que, en effet, le signal n’était plus. Mais beaucoup étaient toujours en attente de voir les résultats officiels lors de la Conférence internationale sur la physique des hautes énergies (International Conference on High Energy Physics – ICHEP 2016), qui a débuté hier à Chicago.

Pour l’anecdote, le document de la collaboration CMS a été accidentellement affecté à la conférence d’hier et la nouvelle s’est répandue comme une trainée de poudre parmi les physiciens sur Facebook et Twitter.

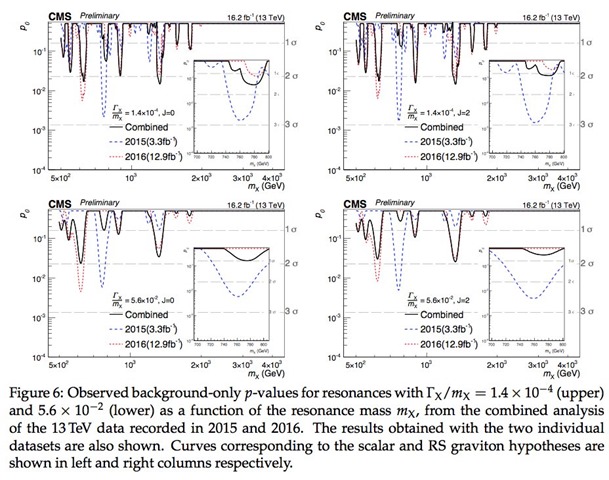

Le physicien Mathew Buckley écrit dans un tweet accompagné d’un graphique du récent rapport :

Ces chiffres du CMS montre le résultat : bleu étaient les anciennes valeurs p. rouge les nouvelles. noir les combinées.

Désormais, toutes les données sont officielles et oui, les rumeurs étaient vraies : le signal a disparu et sans l’aide d’un petit animal, c’était juste un “glitch” dans les données.

De toute évidence, les physiciens sont maintenant très déçu. La perte du diphoton GeV 750 est un grand coup pour la communauté de la physique des particules, bien que bon nombre avaient déjà ce pressentiment.

Mais tout cela n’est, en réalité, pas aussi déprimant que cela puisse paraître. Pour commencer, il y a tout un tas de nouvelles découvertes qui seront annoncées lors de la conférence de l’ICHEP ce week-end. De plus, le fait d’avoir davantage preuves pour soutenir le modèle standard ne fait que renforcer notre compréhension de la physique et confirme que nous sommes sur la bonne voie dans nos tentatives pour démêler les secrets de l’Univers.

Le rapport annonçant la mauvaise nouvelle sur le site du CERN présenté lors de la conférence ICHEP 2016 : Search for resonant production of high mass photon pairs using 12.9fb−1 of proton-proton collisions at s√=13 TeV and combined interpretation of searches at 8 and 13 TeV.

Je pense que les sites de vulgarisation et de presse étaient bien plus hystériques à propos de ces bumps que les physiciens du CERN.

L’annonce officielle de décembre était claire: on voit un bump, on a une politique de transparence, donc, on l’annonce, mais cela peut très bien être une fluctuation statistique.

Les nouvelles données n’ont pas été analysées avec frénésie, cela serait une catastrophe au niveau de la méthodologie qui implique de ne pas favoriser une région particulière au détriment d’une autre.

Je pense que très très peu de physiciens ont réellement été déçu (ou p-e les spoke-persons qui voulaient gagner en célébrité): le fait que ce soit une fluctuation n’était pas une surprise.

Vous avez peut-être raison…

Cependant, que pensez-vous des nombreuses publications scientifiques qui ont fait suite à cette annonce (plusieurs centaines) ?

Un effet d’aubaine (publicitaire) pour des théories marginales ?

Je pense que plus d’un physicien théorique (c’est à dire, un humain, avec sa part d’irrationalité) à croisé les doigts en se disant « et si jamais »…

N’est-il pas ?

Explorer un maximum de possibilités et le faire en anticipant la découverte ne me parait que logique et sain.

Les théoriciens travaillant déjà sur un modèle qui peut être compatible avec l’excès potentiel ont tout intérêt à prévenir le monde scientifique que ce modèle existe.

Ce serait stupide de laisser les expérimentateurs lire tout les articles théoriques à la recherche des 1% de modèles qui permettent d’expliquer l’excès.

Ces modèles ont tout intérêt à être connus et suffisamment développés/étudiés avant la confirmation de l’excès, car observer un excès, établir une limite d’incompatibilité avec le modèle standard et établir une limite de compatibilité avec un modèle particulier n’est pas la même chose.

Les théoriciens ont donc bel et bien fait leur travail en permettant aux expérimentateurs d’avoir à temps toutes les simulations des différents modèles prometteurs avant la confirmation de l’excès (car cela prend du temps de mettre en place ces simulations).

Cela permet aussi de rétablir les priorités des conditions de détection: personne ne veut se rendre compte après avoir accumulé les données qu’il aurait fallu conserver des informations qui ne l’ont pas été. En effet, énormement de données sont pré-selectionnées, sur base de conditions de déclenchement. Si un modèle compatible avec l’excès implique par exemple un autre excès dans une région fortement pré-selectionnée, il faut le savoir avant d’accumuler les données.

Je pense qu’en effet, certains scientifiques se sont dit « si jamais », mais je pense que cela n’est qu’une minorité du phénomène. Même si les théoriciens eux-mêmes étaient convaincus que l’excès disparaitrait avec plus de données, anticiper le fait qu’il ne le soit pas reste la bonne chose à faire.