Le Guru ne va pas détailler une découverte scientifique ou technologique, mais une réflexion philosophique et vitale qui pourrait être mise sous forme de loi, en attendant que l’intelligence artificielle fasse rentrer en ligne de compte les trois lois de la robotique d’Asimov (détaillées plus bas)…

L’utilisation de drones autonomes, des "robots tueurs" qui pourraient utiliser des armes sans un contrôle humain, doit être interdite par un traité international, c’est ce qui ressort d’un rapport établi par une organisation internationale défenseurs des droits humains (Human Rights Watch – HRW) et des avocats.

Selon ce texte, les armes en cours de développement, qui pourraient choisir et attaquer des cibles sans intervention humaine, devraient être interdites de façon préventive en raison du danger qu’elles représentent pour les civils dans les conflits armés.

“Losing Humanity – The Case against Killer Robots”, un rapport de 50 pages prévient que les armes entièrement autonomes ne disposeraient pas des qualités humaines qui fournissent des contrôles juridiques et non juridiques sur le meurtre de civils.

Selon Steve Goose du HRW :

Donner aux machines le pouvoir de décider qui vit et meurt sur le champ de bataille pousserait la technologie trop loin. Le contrôle humain d’une guerre robotique est essentielle pour minimiser les morts et les blessés civils.

L’organisation de défense des droits de l’homme basée à New York a indiqué que son rapport était fondé sur des recherches approfondies sur le droit, la technologie et l’éthique des armes proposées. Il a été publié en collaboration avec la Harvard Law School international human rights clinic.

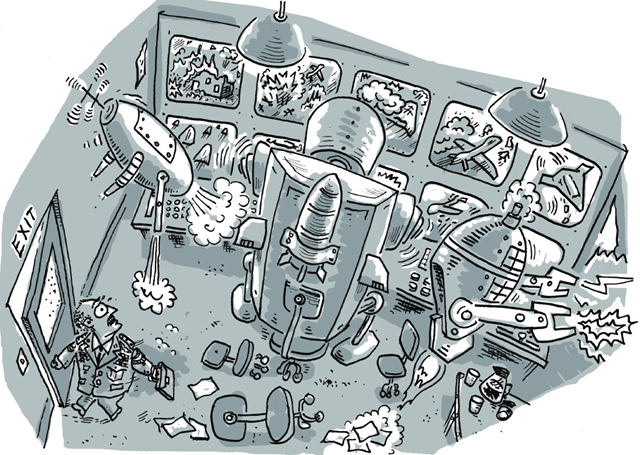

La couverture du récent rapport de l’Human Right Watchs :

Ils ont demandé un traité international, soutenu par une législation nationale, qui interdit absolument le développement, la production et l’utilisation des armes entièrement autonomes.

Ces armes n’existent pas encore et les grandes puissances, y compris les États-Unis, n’ont pas décidé de les déployer. Mais des précurseurs sont déjà en cours de développement. Les États-Unis, la Chine, l’Allemagne, Israël, la Corée du Sud, la Russie et la Grande-Bretagne sont engagés dans la recherche et le développement de telles armes. De nombreux experts prédisent que la pleine autonomie des armes pourrait être atteinte dans 20 à 30 ans, ou même plus tôt, selon le rapport.

Selon Goose :

Il est essentiel d’arrêter le développement de robots tueurs avant qu’ils apparaissent dans les arsenaux nationaux. En tant que pays à devenir plus investi dans cette technologie, il deviendra plus difficile de les convaincre d’y renoncer.

Des armes entièrement autonomes seraient incapables de faire la distinction entre les soldats et les civils sur le champ de bataille ou d’appliquer le jugement humain nécessaire pour évaluer la proportionnalité d’une attaque, si le préjudice civil l’emporte sur l’avantage militaire.

Les robots entraveraient également les contrôles non juridiques des meurtres de civils, avertit le rapport. Ils ne peuvent pas montrer de la compassion pour leurs victimes humaines et les autocrates pourraient abuser d’eux en les dirigeant contre leur propre peuple.

Alors que le remplacement des troupes humaines par des machines pourrait sauver des vies militaires, il pourrait aussi rendre les déclarations de guerre plus facile, ce qui transfèrerait le fardeau des conflits armés sur les civils.

L’utilisation d’armes entièrement autonomes a également soulevé des questions de responsabilité, a indiqué le HRW. Étant donné qu’un tel robot pourrait identifier une cible et lancer une attaque par ses propres moyens, il serait difficile de savoir qui doit être tenu pour responsable des actes illicites qu’il commet.

"Il faut agir maintenant, avant que les robots tueurs franchissent la ligne de la science-fiction à la faisabilité”, a déclaré Goose.

Le rapport de l’Human Rights watch : Losing Humanity – The Case against Killer Robots.

Et le Guru terminera donc avec cette présentation vidéo des 3 lois de la robotique de et par le grand écrivain de science-fiction, Isaac Asimov :

- Un robot ne peut porter atteinte à un être humain, ni, restant passif, permettre qu’un être humain soit exposé au danger.

- Un robot doit obéir aux ordres que lui donne un être humain, sauf si de tels ordres entrent en conflit avec la Première loi.

- Un robot doit protéger son existence tant que cette protection n’entre pas en conflit avec la Première ou la Deuxième loi.

alors autant je suis d’accord sur le fait qu’il faut nous éviter un avenir à la Terminator, autant l’argument comme quoi les robots ne feraient pas la différence entre civils et militaires, ainsi que l’argument « un humain est plus à même de limiter les dégâts » sont ridicules, l’homme à tué des dizaines et des dizaines de millions d’autres hommes en guerre ou non, il est bien plus dangereux qu’une machine pour ses semblables ! quitte a faire la guerre, je préfère que ce soit des robots qui s’affrontent entre eux!!!

Quid de la loi zero de la robotique ?

Si je me souviens bien, il y a une quatrième loi énoncé dans le dernier livre du cycle des robots qui dit quelque chose du genre :

Un robot peut porter atteinte à un être humain si cela peut permettre d’en sauver plusieurs autres.

Autant Asimov a été très visionnaire la-dessus, autant cette dernière loi souvent oubliée est très discutable selon moi et constitue le premier pas vers de la « subjectivité robotique » difficilement prévisible/contrôlable.

Malheureusement concernant l’existence de telles armes,

elles sont déjà prêtes à l’emploi sur le terrain.

L’armée américaine dispose déjà de sentinelles armées autonomes

mais ne les ont pas déployées en Irak de peur de déshumaniser

le conflit et surtout d’augmenter le ressentiment à leur égard

et s’attirer les foudres de la communauté internationale.